Bah ça partait très bien au début, ça m’a grave fait marrer

Et puis…

Bah ça partait très bien au début, ça m’a grave fait marrer

Et puis…

Brb, I must warn my ancestors of 1789 that they should have overthrown the monarchy by discussing politely rather than by cutting off the king’s head and fighting his henchmen

What are you talking about?

Edit: guess I’ll never know

I blocked lemmy.ml instance, as a lot of people have already done

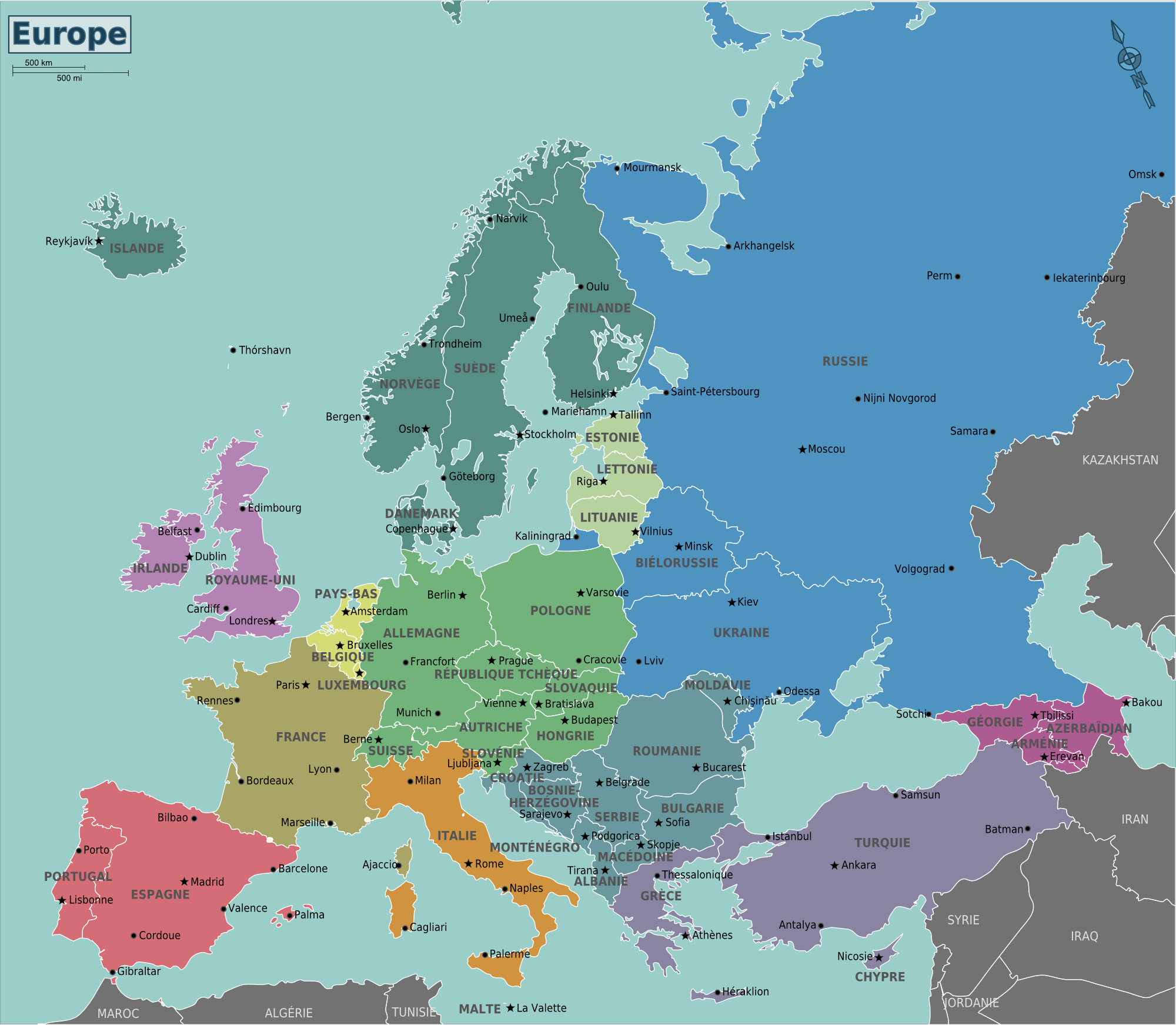

c’est après l’invasion par la Russie en 2014 que l’Ukraine a cherché ouvertement à rejoindre frontalement l’OTAN.

Donc la Russie a envahi l’Ukraine, qui face à cette attaque, s’est rapprochée de l’OTAN pour sa défense, ce qui, selon toi, a provoqué la deuxième invasion de l’Ukraine.

Donc, c’est la Russie qui est responsable sur toute la ligne, parce que c’est parce qu’elle n’a pas respecté ses engagements (Mémorandum de Budapest, notamment) et s’est montrée agressive et belliqueuse, que l’Ukraine a cherché des alliés pour se défendre.

C’est d’ailleurs aussi à cause des menaces et des exactions commises par Poutine que d’autres pays, comme la Finlande ou la Suède, après des décennies de neutralité, ont vu leur opinion populaire basculer fortement vers l’adhésion à l’OTAN.

Prétendre que l’OTAN, qui était en état de mort cérébrale depuis des années, est responsable du comportement de la Russie, n’est rien d’autre que de la propagande Russe. Poutine a ouvertement pour ambition d’effacer le pays Ukrainien de la carte, il a été très clair dans sa communication, et l’OTAN n’a rien à voir là-dedans.

According to GrapheneOS, a security-oriented Android Open Source Project (AOSP)-based distro: “The app doesn’t provide client-side scanning used to report things to Google or anyone else. It provides on-device machine-learning models that are usable by applications to classify content as spam, scams, malware, etc. This allows apps to check content locally without sharing it with a service and mark it with warnings for users.”

So it does not scan your photos, it’s a library that can be used by apps. I think the point is to allow apps to reject or tag a picture without ever sending it to a server for scanning, thus taking off the load of these servers and putting it on the client-side.

Like, you’re trying to post a story on Instagram, the app asks Safetycore if the picture contains porn/violence/something they don’t want, Safetycore says yes/no, and Instagram accepts and tag or refuses the picture accordingly.

The danger here IMO is less about privacy and more about censoring : we know every time something is pushed to fight child porn, it ends up used to control activists and political opponents. People may be restricted to share proofs of police violence for example.

No problem if you’re using Lemmy, you can use any front-end, so you can use an app that won’t use SafetyCore.

Quel est votre avis sur Le Grand Continent ? Je vois qu’ils ont publié des contributions de gens pas très respectables comme, entre autres, Vladislav Sourkov (cadre de la Russie de Poutine et l’un des artisans de l’invasion en Ukraine), ou Bruno Tertrais (membre du Collectif des climato-réalistes, AKA un climatosceptique), et ça ne me rassure pas des masses.

Être outré =/= être surpris

Comme tu l’as dit, c’est très bien d’être outré par ce genre de comportement, sinon ça veut dire que c’est normalisé, et que la prochaine fois sera pire.

Maintenant, il faut que l’outrage se traduise par de l’action, sinon c’est du vent.

Brigite Paragot recommande un cocktail bien spécifique, contenant un tiers de sirop de fruits rouges, un tiers de bière brune, et un tiers de vin blanc. Ce dernier va agir comme un répulsif pour les abeilles,

Ah c’était la question que je me posais directement. Bon bah je note l’astuce pour cet été

Most instances will stop allowing new accounts to be created when it reaches a certain size that gets difficult to manage (hardware and moderating-wise). They self-regulate that way, and instances that get out of control will just be defederated by the others.

Where did you get that idea from? i7-6700k can idle at lower than 4W